Seit der Veröffentlichung einer Studie der Technischen Universität Hamburg in Kooperation mit dem Kompetenzportal RiskNET [vgl. Meyer/Romeike/Spitzner 2012] im Jahr 2012 hat sich nicht allzu viel geändert. Die Studie kam zu dem Ergebnis, dass Simulationsmethoden der Ruf vorauseilt zu komplex zu sein. Des Weiteren konnte als Ergebnis herausgearbeitet werden, dass das Management in der Regel auf nur geringe Erfahrungen mit Simulationen zurückgreifen kann. Entscheider setzen hingegen bekannte und vermeintlich einfachere Methoden ein.

Neugier und das Denken in Szenarien

Warum halten so viele Menschen Komplexität für so kompliziert? Vielleicht haben sie über das Erwachsenwerden das "Spielen" verlernt [vgl. Heinrich 2018]. Auch das fehlende "Erleben" von Simulationen konnte mit der damaligen Studie als Grund für den Nichteinsatz von Simulationen aufgezeigt werden.

Geradeso wie in allen anderen Disziplinen, spielen auch bei der Steuerung von Komplexität die Neugier, das Denken in Szenarien und schließlich die Simulation eine wichtige Rolle [vgl. Fornefett 2014]. Ein dynamisch-komplexes Modell gemeinsam mit anderen Menschen zu analysieren und so in der Gruppe eine Lösung für ein Problem zu erarbeiten, setzt voraus, dass man nicht nur das Verhalten eines modellierten Systems über längere Zeit beobachtet und diskutiert, sondern auch gemeinsam die Modell-Variablen aus den Modell-Bedingungen ableitet. Man muss dazu bereit sein, mit anderen Menschen vernetzt zu denken und zu spielen. Wie damals als Kinder im Sandkasten.

Modelle und Simulationen sind als Hilfsmittel für den Umgang mit der Realität vermutlich so alt wie die Menschheit selbst. Statische Objekte der Planung, wie Bauwerke, Boote oder Maschinen wurden bereits vor Jahrtausenden zunächst als Modelle gebaut und geprüft, Kinder simulieren die Welt der Erwachsenen und lernen so nicht nur aus deren Erzählungen. Aber auch Instrumente wie Storytelling, War Games oder andere Planspiele gehören heute zu den probaten Mitteln einer qualitativen Modellierung und Simulation [vgl. Romeike/Spitzner 2013]. Heute erlaubt uns die Entwicklung von Computern und Software, insbesondere im Hinblick auf Schnelligkeit und Präzision, die Modellbildung und Simulation an heutige Erfordernisse anzupassen.

Qualitative Instrumente wie "Feedback-Diagramme" oder "Bestands- und Flussgrößendiagramme" an der Leinwand verdeutlichen bereits verschiedene Dimensionen eines zu lösenden dynamischen Problems und verbessern dadurch dessen Transparenz und Kommunizierbarkeit. Solche sind im Kleinen sogar noch mental simulierbar. Das heißt die dynamischen Konsequenzen der untersuchten Struktur lassen sich im Kopf durchspielen. Allerdings stößt das menschliche Gehirn sehr rasch an Grenzen [vgl. Kritzner 2014].

Bei Verwendung moderner Simulations-Software ist das Simulieren am Ende Sache eines Mausklicks. Allerdings müssen dafür qualitative Modelle zunächst in quantitative Modelle überführt werden. Dies kann per "Kopf und Hand" oder wiederum mit Unterstützung entsprechender Software geschehen. Es existieren dafür eine ganze Reihe von Lösungen, Methoden und Tools, die auf eine Erstellung, Simulation oder Analyse dynamisch-komplexer Modelle spezialisiert sind. Modelle lassen sich aber auch mit vielen Programmiersprachen wie C++, Python, Java, Pascal oder Fortran selbst erstellen.

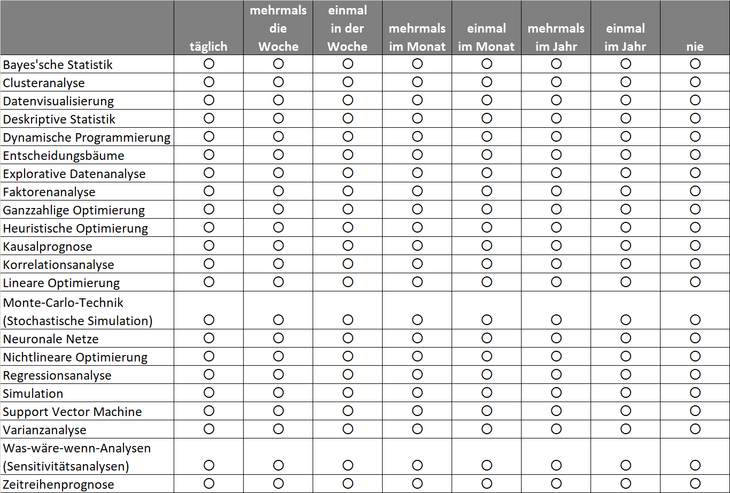

Prüfen Sie vielleicht einmal für sich: Wie häufig nutzen Sie bereits die ein oder andere der folgenden analytischen Techniken bei komplexen Herausforderungen?

Tab. 01: Analytische Methoden zur Analyse von Komplexität [Download als pdf-Datei]

Tab. 01: Analytische Methoden zur Analyse von Komplexität [Download als pdf-Datei]

Vom "Systemdenken" zum "Komplexitätsdenken"

Das wichtigste Ziel von Simulationsmodellen stellt seit je her die Unterstützung bei der Analyse und dem Verstehen des Systemverhaltens komplizierter als auch komplexer Systeme dar. Ein Beispiel hierfür ist der von Jay W. Forester Mitte der 50er Jahre entwickelte System-Dynamics-Ansatz [vgl. Forrester 1975].

Auf diesem Ansatz basiert unter anderem das häufig kritisierte World3-Modell, eine kybernetische Computersimulation, um die Wechselwirkungen zwischen Faktoren wie Bevölkerung, industriellem Wachstum, Nahrungsmittelproduktion und deren Einfluss auf mögliche Grenzen in Ökosystemen der Erde zu erforschen.

![Abb. 01: World3, Diagram of limits to growth in the world system / Commissioned by the Club of Rome, 1972 [Quelle: Club of Rome] Abb. 01: World3, Diagram of limits to growth in the world system / Commissioned by the Club of Rome, 1972 [Quelle: Club of Rome]](/fileadmin/_processed_/f/9/csm_Abb-01_World3_20190205_92cf05304d.png)

Abb. 01: World3, Diagram of limits to growth in the world system / Commissioned by the Club of Rome, 1972 [Quelle: Club of Rome]

Wer das Modell selbst einmal durchspielen möchte, findet unter dem folgenden Link einen kostenfreien Download für die entsprechende Software.

Erkenntnisse und das Verständnis für Systeme und ihre Prozesse werden vor allem im Zeitverlauf durch eine kontinuierliche Simulation gewonnen und Resultate zur Prüfung der Wirksamkeit verschiedener Lösungsansätze generiert. Die Anwendungen im Unternehmen sind potentiell breit gefächert, beispielsweise:

- Produktionsmanagement, strategische Planung, Geschäftsmodellanalysen, Businessplanungen, Szenarioanalysen,

- Analyse der Bevölkerungsentwicklung, Analyse von Umweltbeeinträchtigungen,

Entwicklung von Katastrophen, - Erklärungsansätze für komplexes, vom menschlichen Willen getragenes, soziales Verhalten.

Im Kern werden organisierte Systeme und ihre Komponenten analysiert und in einen relationalen oder Wirkzusammenhang gebracht. Dadurch ergeben sich in der Regel vernetzte Strukturen, deren gegenseitige Beeinflussung in ihrer Dynamik unter Einbeziehung von Lebewesen so komplex wird, dass das Systemverhalten im Zeitverlauf nicht mehr analytisch vorhersagbar ist [vgl. Fornefett 2018].

Entweder wird das betrachtete System auf einer aggregierten Ebene in sich geschlossen formuliert, das heißt mit definierten Systemgrenzen. Oder es werden Modellierungsmethoden und -tools eingesetzt, die nicht von der aggregierten Ebene aus das Gesamtsystem beschreiben. Deren einzelne Systemteilnehmer besitzen auf sogenannter Mikroebene als einzelne Akteure eines Systems "individuelle" Verhaltensweisen und Entscheidungsmöglichkeiten. Die Systemteilnehmer werden als Agenten bezeichnet, das System als Ganzes als ein "Multiagent-System".

Das Systemverhalten bestimmt sich danach aus der Vielfalt der einzelnen, individuellen Verhaltensweisen und Verhaltensmöglichkeiten der Systemteilnehmer. Beispiele hierfür bilden Warteschlangenmodelle an Kaufhaus-Kassen oder Analysen zur Entwicklung eines Staus im Straßenverkehr.

Der Vorteil letztgenannter Ansätze ist, dass sowohl heterogenes Verhalten der Systemteilnehmer als auch die Abhängigkeiten und Interaktionsmuster zwischen den verschiedenen Systemteilnehmern berücksichtigt werden können. Das Verhalten des übergeordneten Gesamtsystems ergibt sich danach aus den Rahmenbedingungen des Modells und der Definition und Beschreibung der einzelnen Systemteilnehmer und deren gegenseitige Interaktionen [vgl. zur Vertiefung Fornefett 2012].

Der Vorteil der agentenbasierten Simulation auf der Mikroebene (auch "Mikrosimulation" genannt) ist, dass auf einer Ebene die Verhaltensparameter der jeweiligen Systemteilnehmer abgebildet werden und davon getrennt das zunächst angenommene Systemverhalten als Ganzes. Dabei spielt es keine Rolle, ob das System ein Gleichgewicht erreicht oder nicht. Dies ist im Übrigen entgegen gängiger Meinung auch nicht die Grundannahme bei den System-Dynamics-Modellen.

Es ist durchaus möglich das Kaufverhalten von Konsumenten unter Berücksichtigung von Einkommen, Haushaltsgröße, Regionalität, Markttransparenz etc. abzubilden, um so mögliche betriebswirtschaftliche Aspekte besser zu verstehen oder ein Modell des Konsumgütermarkts auf volkswirtschaftlicher Basis. Das bedeutet, dass Mikrosimulationsmodelle auch in volkswirtschaftliche Makromodelle eingebunden werden können ("Mikro-Makro-Simulation").

Ferner können Simulations-Modelle hinsichtlich ihres zeitlichen Verhaltens kategorisiert werden, einerseits zeitkontinuierliche Modelle und andererseits ereignisgesteuerte Modelle u.v.m.

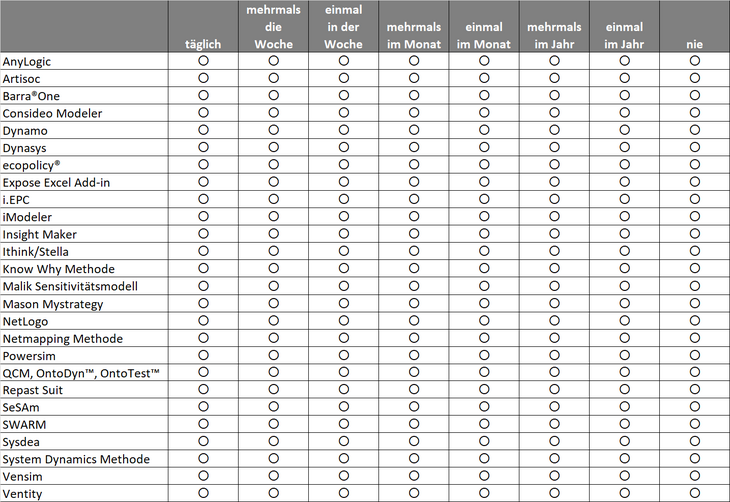

Wie häufig nutzen Sie die folgenden Methoden und Tools zur Modellierung und Simulation komplexer Fragestellungen?

Tab. 02: Methoden und Tools zur Modellierung und Simulation komplexer Fragestellungen [Download als pdf-Datei]

Komplexitätssteuerung ist kein Hexenwerk

Im Zeitalter der Globalisierung und Digitalisierung bildet Komplexitätsmanagement einen Wettbewerbsvorteil. Unternehmen stehen vor der Herausforderung, auf hoch vernetzte und zunehmend rasche und unvorhersehbare Marktentwicklungen rasch und flexibel mit intelligenten Produkten, Strategien und Organisationsformen antworten zu müssen. Die Fähigkeit zum "Komplexitätsmanagement" wird neben der Fähigkeit zur "Agilen Führung" (beides verknüpft auch "Komplexitätssteuerung" genannt) inzwischen zu einem wesentlichen Faktor, der über Erfolg oder Misserfolg eines Unternehmens entscheidet. Intelligentes Komplexitätsmanagement bedeutet eine Personal- und Organisationsentwicklung, die sich nicht mehr allein auf traditionelle Kennzahlen, rein ökonomische Fähigkeiten oder Leistungspotentiale stützt [vgl. Kritzner/Fornefett 2017]. Heute liegt der Fokus auf einer nachhaltigen Förderung von integrativen Kompetenzen, die der Komplexität unternehmerischen Handelns unter den Bedingungen einer globalisierten und digitalisierten Welt gerecht werden. Auf diese Situation haben sich viele Unternehmen bisher kaum bis zögerlich vorbereitet. Der wachsenden Unvorhersehbarkeit, Dynamik und Vernetzung unternehmerischen Handelns werden sie damit kaum gerecht.

Komplexitätsmanagement ist also kein Mythos [vgl. Malik 2017]. Es kann gelernt, eingeübt und mit Erfolg in die unternehmerische Praxis umgesetzt werden. Und wer die grundlegenden Strukturen und Prozesse komplexer Handlungsfelder kennt und zugleich auf die konkreten unternehmerischen Ziele und Strategien anzuwenden weiß, trägt auch künftig zum Unternehmenserfolg bei.

Quellenverzeichnis sowie weiterführende Literaturhinweise:

- Fornefett, A. (2012): Transparenz und Wahrheit – Subjektive und objektive Grenzen von Transparenz, in: Everling, O. et al (Hrsg.) (2012): Transparenzrating, Springer Gabler Verlag, Wiesbaden 2012.

- Fornefett, A. (2014): Risikomanagement komplexer Systeme, in: RiskNews vom 05.08.2014, www.risknet.de/themen/risknews/risikomanagement-komplexer-systeme/

- Fornefett, A. (2018): Wird uns die Welt zu komplex? in Forum Nachhaltig Wirtschaften, 01/2018, S.34f.

- Forrester, J. W. (1975): Collected Papers, Wright Allen Press, Cambridge, 1975.

- Heinrich, Christian et.al. (2018): Wie Erwachsene verlorene Spielkompetenz zurückgewinnen können, in: Magazin komplex, 1/2018, S.41ff.

- Kritzner, Ulrich et.al. (2014): Bevor wir etwas Neues tun, müssen wir etwas Neues denken! In: Kredit & Rating Praxis, 5/2014, S.1ff.

- Kritzner, U./Fornefett, A. (2017): Im Dialog vernetzen, in: Magazin komplex, 1/2017, S.37ff.

- Malik, F. (2017): Komplexität nutzen! in Magazin komplex, 1/2017, S.6ff.

- Meyer, M./Romeike, F./Spitzner, J. (2012): Simulationen in der Unternehmenssteuerung – Studienergebnisse, RiskNET GmbH, Brannenburg/Wendelstein 2012.

- Romeike, F./Spitzner, J. (2013): Von Szenarioanalyse bis Wargaming. Betriebswirtschaftliche Simulationen im Praxiseinsatz, Wiley-VCH, Weinheim 2013

Autor:

Andreas Fornefett ist Vorstand der EPOTECH AG, Kelkheim, einem Spezialisten für Komplexitätsmanagementberatung sowie IT-Entwicklung und Vertrieb. Seit Jahresbeginn ist er zugleich Partner und Aufsichtsratsvorsitzender der DENNSO AG, Hamburg, geworden. Diese ist Holding einer Unternehmensgruppe, der auch die EPOTECH AG seit kurzem angehört.