Ein kühler Abend in Basel, Ende des 17. Jahrhunderts. In einem Studierzimmer sitzt Jakob Bernoulli über Zahlenkolonnen gebeugt. Vor ihm liegen Aufzeichnungen von Münzwürfen – hunderte, vielleicht tausende Versuche. Anfangs schwanken die Ergebnisse wild: mehr Köpfe, dann wieder mehr Zahlen. Doch je länger die Serie wird, desto ruhiger scheint sich das Verhältnis einzupendeln. Fast mag es so wirken, als würde sich in der Unordnung eine verborgene Ordnung offenbaren.

Diese Beobachtung führte Bernoulli zu einer der einflussreichsten Erkenntnisse der Wahrscheinlichkeitstheorie: dem Gesetz der großen Zahlen. Es besagt, dass bei wachsender Anzahl von Wiederholungen die relativen Häufigkeiten stabiler werden und sich dem erwarteten Wert annähern.

Doch genau hier beginnt die eigentliche Pointe – und das Missverständnis. Denn Stabilität bedeutet nicht Sicherheit. Auch wenn sich Durchschnittswerte beruhigen, bleiben einzelne Abweichungen möglich, teilweise sogar extrem. Große Zahlen glätten die Oberfläche, aber sie eliminieren nicht die Unsicherheit.

Wo der Zufall Ordnung bekam

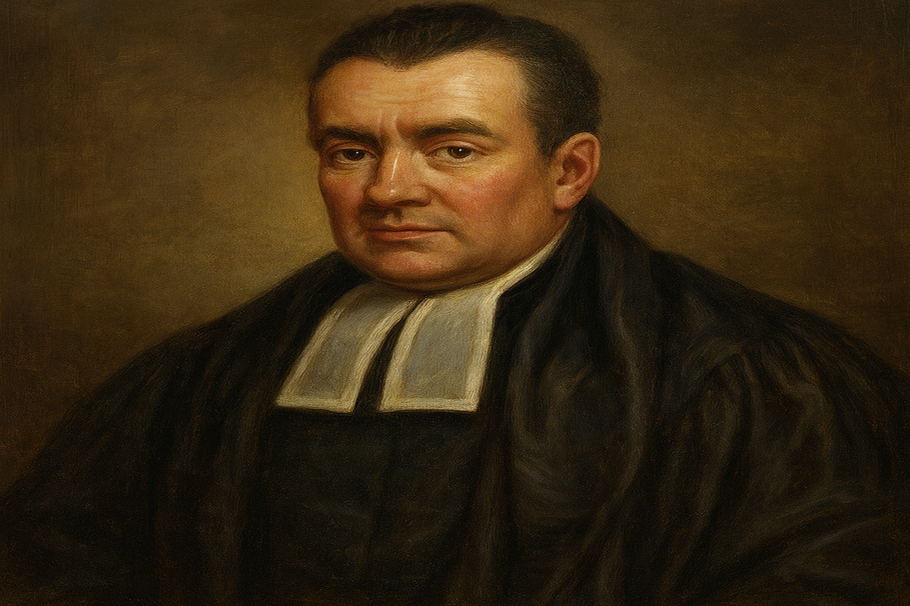

Diese Einsicht fiel nicht vom Himmel. Jakob Bernoulli wurde am 27. Dezember 1654 in Basel geboren und wuchs in einer Familie auf, die für ihn zunächst keine mathematische, sondern eine theologische Laufbahn vorsah. Er folgte dem Wunsch seines Vaters und studierte Theologie; bereits 1671 erwarb er den Grad eines Magisters der Philosophie, einige Jahre später legte er die Abschlussprüfung ab. Seine eigentliche Leidenschaft galt jedoch schon früh der Mathematik. Vieles, was er auf diesem Gebiet beherrschte, eignete er sich autodidaktisch an – nicht als Freizeitbeschäftigung, sondern mit dem Ernst eines Forschers, der spürt, dass in Zahlen eine eigene Form von Erkenntnis liegt.

Zwischen 1676 und 1682 reiste Bernoulli durch Frankreich, England, Holland, Deutschland und die Schweiz. Für seine wissenschaftliche Entwicklung waren diese Bildungsreisen von entscheidender Bedeutung. Er begegnete dabei einigen der bedeutendsten Forscher seiner Zeit, darunter dem irischen Naturforscher Robert Boyle und dem englischen Universalgelehrten Robert Hooke. Auf diese Weise gewann er unmittelbaren Einblick in die naturwissenschaftlichen Debatten der frühen Neuzeit und fand Anschluss an jene intellektuellen Netzwerke, die das Denken Europas veränderten. Nach seiner Rückkehr nach Basel hielt er private Vorlesungen über Experimentalphysik, insbesondere über mechanische Fragestellungen. Im Jahr 1682 veröffentlichte Bernoulli mit "Conamen novi systematis cometarum" ("Versuch eines neuen Systems der Kometen") eine frühe wissenschaftliche Schrift, in der bereits sein Anspruch sichtbar wird, Naturphänomene nicht nur zu beschreiben, sondern mit Hilfe mathematischer Überlegungen systematisch zu erklären und, soweit möglich, vorauszuberechnen.

Als 1687 der Lehrstuhl für Mathematik an der Universität Basel frei wurde, erhielt Bernoulli die Professur. Er behielt sie bis zu seinem Tod im Jahr 1705. In diesen Jahren arbeitete er an unendlichen Reihen, an Problemen der Infinitesimalrechnung und an geometrischen Kurven. Er beschäftigte sich intensiv mit den naturphilosophischen und erkenntnistheoretischen Schriften René Descartes und suchte den Austausch mit dem Universalgelehrten Gottfried Wilhelm Leibniz, um die neue Analysis zu verstehen und weiterzuentwickeln. Jakob Bernoulli war also keineswegs nur der Mann eines einzigen Satzes. Er gehörte zu jener Generation, in der sich ein neues wissenschaftliches Denken durchsetzte: Die Welt wurde nicht mehr nur qualitativ oder exemplarisch gedeutet, sondern zunehmend analytisch, strukturell und quantitativ beschrieben.

Die Kunst des Vermutens

Gerade in diesem Kontext gewinnt Bernoullis Hauptwerk sein besonderes Gewicht. Die Forschung zur Entstehung der Wahrscheinlichkeitstheorie spricht rückblickend von der schwierigen Geburt der Stochastik. Bernoulli selbst verstand seine Untersuchungen über das mathematisch fassbare Ungewisse als eine Kunst des begründeten Vermutens. Schon der Titel seines 1713 postum erschienenen Hauptwerks "Ars Conjectandi" lässt sich als "Die Kunst des Vermutens" oder "Die Kunst des Schließens unter Unsicherheit" lesen. Gemeint ist gerade nicht bloßes Rätselraten, sondern eine Methode, aus unvollständiger Information vernünftige Schlüsse zu ziehen.

Das war neu. Vor Bernoulli hatte man zwar Glücksspiele analysiert und einzelne Probleme der Kombinatorik oder Erwartungswertrechnung gelöst. Doch Bernoulli verschob den Horizont. Wahrscheinlichkeit sollte nicht bloß erklären, wer beim Würfeln gewinnt, sondern auch in zivilen, moralischen und ökonomischen Angelegenheiten Orientierung bieten. Das ist der eigentliche Bruch: Aus der Kunst des Wettens wurde eine Theorie des Lernens aus Erfahrung. Aus dem singulären Zufallsereignis wurde ein Gegenstand systematischer Erkenntnis.

Gerade deshalb ist es sinnvoll, Bernoulli nicht nur als frühen Wahrscheinlichkeitsrechner, sondern als Architekten einer neuen wissenschaftlichen Haltung zu lesen. Das Ungewisse erschien bei ihm nicht länger als bloßes Gegenstück zum Wissen, sondern als Feld, das sich unter bestimmten Bedingungen strukturieren ließ. Die Stochastik beginnt hier als intellektuelle Disziplin der Bescheidenheit: Man weiß nicht alles, aber man kann dennoch vernünftig urteilen. In diesem Sinn steht Bernoulli auch für die Überzeugung, dass mathematische Ordnung keine Randnotiz der Wissenschaft ist, sondern ihre tragende Form.

Bernoullis goldener Satz

Im Zentrum dieser neuen Denkweise steht das Gesetz der großen Zahlen. Seine Grundidee ist auf den ersten Blick einfach. Wenn ein Zufallsvorgang unter gleichbleibenden Bedingungen oft genug wiederholt wird, dann stabilisieren sich die beobachteten Häufigkeiten um einen Erwartungswert. Wer eine faire Münze nur zehnmal wirft, kann leicht drei- oder achtmal Kopf erhalten. Wer sie zehntausendmal wirft, wird sich mit hoher Wahrscheinlichkeit der Hälfte annähern. Nicht weil die Natur eine kurze Serie ausgleichen müsste, sondern weil sich in langen Reihen die relative Häufigkeit beruhigt.

Gerade dieser Punkt ist wichtig, weil das Gesetz der großen Zahlen bis heute oft missverstanden wird. Es ist kein Gesetz des Ausgleichs im Sinne einer Schicksalskorrektur. Wenn in den ersten Würfen ungewöhnlich oft Zahl fällt, dann schuldet die Münze der Zukunft nichts. Bernoullis Satz sagt nicht, dass die Welt Unregelmäßigkeiten aktiv kompensiert. Er sagt lediglich, dass die Bedeutung einzelner Zufallsschwankungen mit wachsender Zahl der Beobachtungen relativ kleiner wird. Konvergenz ist keine moralische Wiederherstellung des Gleichgewichts, sondern ein statistischer Grenzprozess.

Bernoullis Leistung bestand überdies nicht nur darin, diesen Grenzgedanken mathematisch zu formulieren. Er stellte auch die praktische Frage, wie viele Beobachtungen nötig sind, um aus Erfahrung verlässliche Schlüsse zu ziehen. Genau darin liegt der Schritt von der reinen Theorie zur empirischen Vernunft. Wer Unsicherheit beurteilen will, braucht nicht nur Rechenkunst, sondern auch ein Bewusstsein für Stichprobenumfang, Genauigkeit und die Qualität der zugrunde liegenden Beobachtungen. Gerade deshalb besitzt das Gesetz der großen Zahlen bis heute hohe praktische Relevanz im Risikomanagement: etwa bei der Kalkulation von Schadenhäufigkeiten in großen Versicherungsportfolios, bei der Modellierung erwarteter Ausfälle in breit diversifizierten Kreditbeständen, bei der Abschätzung von Garantie- und Reklamationsquoten in industriellen Serienprozessen oder bei der statistischen Bewertung häufiger, kleiner operationeller Verluste. Überall dort, wo viele hinreichend vergleichbare Einzelereignisse vorliegen, schafft die große Zahl der Beobachtungen eine belastbarere Grundlage für Prognosen – ohne freilich das Problem seltener Extremereignisse zu lösen.

Warum große Zahlen täuschen können

Gerade weil Bernoullis Satz so mächtig ist, wird er oft überdehnt. Große Zahlen machen Ergebnisse enger, aber nicht automatisch wahrer. Sie verringern Zufallsschwankungen unter passenden Bedingungen; sie heilen jedoch keine verzerrte Auswahl, sie machen abhängige Daten nicht unabhängig und sie verwandeln seltene Extremereignisse nicht in harmlose Durchschnittsbewegungen. Der Satz ist stark – aber er ist kein Universalreiniger methodischer Fehler.

Das lässt sich an mehreren Feldern zeigen. In der Wahlforschung kann eine enorme Zahl von Antworten methodisch wenig wert sein, wenn die Stichprobe systematisch verzerrt ist. In der Medizin kann ein großes Beobachtungsregister falsche kausale Schlüsse nahelegen, wenn Confounding oder Selektionsverzerrungen bestehen. In der Finanzwelt wiederum verletzen Märkte die bequemen Annahmen unabhängiger und gleich verteilter Daten notorisch. Renditen zeigen Volatilitätscluster, schwere Tails und instabile Abhängigkeitsmuster. In solchen Fällen erzeugen große Datenmengen nicht selten eine gefährliche Form von Scheingenauigkeit.

Man könnte auch sagen: Das Gesetz der großen Zahlen beruhigt dort, wo es eigentlich zur methodischen Wachsamkeit anhalten sollte. Denn mit jedem wachsenden Datensatz steigt nicht nur die Chance auf statistische Stabilisierung, sondern auch die Versuchung, die Konstruktion des Datensatzes selbst aus dem Blick zu verlieren. Wer nur auf das beeindruckende n schaut, verwechselt Menge mit Güte. Genau das macht große Zahlen trügerisch.

Wenn Mittelwerte Risiken verdecken

Für das moderne Risikomanagement ist diese Einsicht von unmittelbarer Bedeutung. In vielen praktischen Anwendungen werden Risiken aggregiert: Kreditportfolios werden verdichtet, operationelle Schäden in Jahresstatistiken zusammengefasst, Cybervorfälle zu Kennzahlen gebündelt, Schadensverläufe in Erwartungswerten oder Durchschnittskosten dargestellt. Das ist notwendig und oft unvermeidlich. Aber Aggregation hat einen Preis. Sie glättet nicht nur die Oberfläche, sondern verdeckt mitunter genau jene Ränder der Verteilung, an denen sich die wirklich kritischen Risiken konzentrieren.

Ein Portfolio kann im Mittel stabil erscheinen und dennoch durch wenige extreme Ausfälle massiv gefährdet sein. Eine Systemlandschaft kann über Jahre hinweg eine niedrige durchschnittliche Störungsrate aufweisen und dennoch in einem einzelnen Ausnahmeereignis katastrophal versagen. Ein Unternehmen kann in seinen Dashboards vermeintlich beruhigende Durchschnittswerte sehen und gerade dadurch blind werden für Klumpenrisiken, Abhängigkeiten, Schwellenwerte und nichtlineare Kaskaden. Bernoullis Satz erklärt, warum Wiederholung Erkenntnis erzeugen kann. Er warnt aber indirekt auch davor, Durchschnittswerte mit Sicherheit zu verwechseln.

Gerade deshalb reicht es im Risikomanagement nicht, nur den Erwartungswert zu kennen. Man muss die gesamte Verteilung in den Blick nehmen: Streuungen, Schiefe, Ausreißer, Extrembereiche und Modellannahmen. Wer Risiken ausschließlich als mittlere Belastung versteht, verfehlt ihre eigentliche operative und strategische Bedeutung.

Der alte Statistik-Witz bringt das auf den Punkt: Ein Statistiker watet durch einen Fluss, der im Mittel nur einen Meter tief ist – und ertrinkt. So zugespitzt der Witz ist, so präzise beschreibt er das Problem. Der Mittelwert kann beruhigend wirken, gerade weil er die gefährlichen Stellen glättet. Doch Risiken realisieren sich nicht im Durchschnitt, sondern an den tiefen, schiefen und extremen Punkten der Verteilung. Für das Risikomanagement ist das eine banale und zugleich fundamentale Einsicht: Wer nur auf den Mittelwert schaut, verwechselt rechnerische Ordnung mit realer Sicherheit.

Was Bernoulli modernen Entscheidern hinterlässt

Bernoullis Vermächtnis ist deshalb doppeldeutig und gerade darin so fruchtbar. Einerseits zeigt er, dass aus Wiederholung Wissen entstehen kann. Erfahrung muss nicht im Anekdotischen stecken bleiben; sie lässt sich systematisch ordnen. Andererseits zeigt er, wie leicht dieses Wissen überschätzt wird, sobald man vergisst, an welche Bedingungen es gebunden ist. Große Zahlen schaffen Orientierung, aber keine Gewissheit. Sie disziplinieren das Urteil, ersetzen es aber nicht.

Diese Spannung macht den Reiz seines Denkens bis heute aus. Der Blick auf Bernoulli führt zurück an jenen imaginären Basler Schreibtisch, an dem aus Münzwürfen, Sterbelisten und Notizblättern eine neue Wissenschaft des Ungewissen entstand. Was dort begann, lebt heute in Statistik, Versicherungsmathematik, Risikomodellen, Szenarioanalysen und datengetriebenen Entscheidungen fort. Doch die wichtigste Lehre ist vielleicht noch immer dieselbe wie vor mehr als drei Jahrhunderten: Verlässliche Schlüsse verlangen nicht bloß viele Daten, sondern passende Daten, saubere Modelle und intellektuelle Nüchternheit.

Das Fazit ist daher ebenso einfach wie anspruchsvoll. Wer Risiken verstehen will, darf sich nicht mit dem Durchschnitt zufriedengeben. Er muss in die Annahmen schauen, in die Struktur der Daten und in die Extrembereiche der Realität. Gerade dort entscheidet sich, ob Systeme robust sind oder nur stabil aussehen.

Quellenverzeichnis sowie weiterführende Literaturhinweise

- Bernoulli, Jakob (1682): Conamen novi systematis cometarum. Henricus Wetstein, Amsterdam 1682.

- Bernoulli, Jakob (1713): Ars Conjectandi. Impensis Thurnisiorum, Fratrum, Basel 1713.

- Bernstein, Peter L. (1996): Against the Gods: The Remarkable Story of Risk. John Wiley & Sons, New York 1996.

- Gigerenzer, Gerd / Swijtink, Zeno / Porter, Theodore / Daston, Lorraine / Beatty, John / Krüger, Lorenz (1989): The Empire of Chance: How Probability Changed Science and Everyday Life. Cambridge University Press, Cambridge 1989.

- Hacking, Ian (1975): The Emergence of Probability: A Philosophical Study of Early Ideas about Probability, Induction and Statistical Inference. Cambridge University Press, Cambridge 1975.

- Romeike, Frank (2007): Jakob Bernoulli (Köpfe der Risk-Community), in: RISIKO MANAGER, Ausgabe 1/2007, Seite 12-13.

- Romeike, Frank (2015): Beautiful, Colourful Risk: Benoît B. Mandelbrot - Remembering the Father of Fractals, in: Union Investment Institutional [Hrsg.]: The Measurement of Risk, Frankfurt am Main 2015, S. 197-207.