Im Sommer 1654 wurde aus einer Spielerfrage eine Managementfrage von erstaunlicher Haltbarkeit: Wie bewertet man eine Lage, deren Ausgang noch offen ist, über die aber jetzt entschieden werden muss? Aus der Korrespondenz zwischen Pascal und Fermat über das Problem der Partien entstanden die Grundideen von Erwartungswert, Zukunftspfaden und fairer Bewertung unter Unsicherheit. Genau aus diesen Gründen gehört diese Episode nicht ins Kuriositätenkabinett der Mathematikgeschichte, sondern hilft beim Verständnis eines quantitativen Risikomanagements: in erwartete Verluste nach IFRS 9, in den Best Estimate unter Solvency II, in Governance-Entscheidungen über faire Verteilung und in den disziplinierten Umgang mit Modellgrenzen.

Ein Brief aus dem Sommer 1654

Die Szene ist historisch gut belegt. Der französische Mathematiker und Physiker Blaise Pascal schreibt Ende Juli 1654 an den französischen Mathematiker und Juristen Pierre de Fermat, er könne sich nicht zurückhalten zu antworten, "obwohl ich noch im Bett liege". Der Brief, so berichtet er, sei ihm am Vorabend zugegangen; der Gegenstand ist keine Staatskrise und kein theologischer Streit, sondern eine Frage aus der Welt des Glücksspiels. Schon dieser Einstieg verrät, warum die Geschichte bis heute so aktuell ist: Die Mathematik tritt hier nicht als Kathederdisziplin auf, sondern als Reaktion auf eine dringliche, alltäglich wirkende Entscheidung unter Unsicherheit.

Irgendwo zwischen Toulouse und Paris – um Pascals eigene Wendung aufzunehmen, die Wahrheit sei dieselbe in beiden Städten – wird aus einem abgebrochenen Spiel eine Theorie des vernünftigen Entscheidens. Sicher ist: Ein spielaffiner Adliger, Antoine Gombaud, genannt Chevalier de Méré, hat Fragen aus der Welt der Wetten an Pascal herangetragen; sicher ist ebenfalls, dass maßgebliche historische Überblicksdarstellungen den Briefwechsel von 1654 als Gründungsmoment der modernen Wahrscheinlichkeitsrechnung behandeln. Unsicherer ist nur manches Beiwerk der späteren Legendenbildung – und genau so sollte man es auch behandeln.

Für Risikomanager liegt der Witz der Episode auf der Hand. Die eigentliche Frage lautet nicht: Wer liegt gerade vorn? Sondern: Welchen fairen Wert hat eine Position, deren Zukunft offen ist, wenn die Entscheidung eben nicht am Ende, sondern mitten im Spiel fallen muss? Wer Kreditrisiken bewertet, Cashflows von Versicherungen schätzt, Schadensreserven dimensioniert oder in einer Krisensitzung über Fortsetzung, Abbruch und Teilung entscheidet, hantiert im Kern noch immer mit genau diesem Problem.

Zwei Männer, zwei Temperamente

Blaise Pascal war ein Wunderkind mit erstaunlich praktischer Ader. Er wurde 1623 in Clermont-Ferrand geboren, vom Vater unterrichtet, machte früh mit Geometrie auf sich aufmerksam und entwickelte später mit der Pascaline eine der ersten mechanischen Rechenmaschinen Europas. Gleichzeitig beschreiben Standardbiografien ihn als körperlich fragil, oft krank und geistig von einer fast überhitzten Intensität. Das passt zu seinem Stil im Partienproblem: schnell, präzise, methodisch, allergisch gegen jeden Nebel.

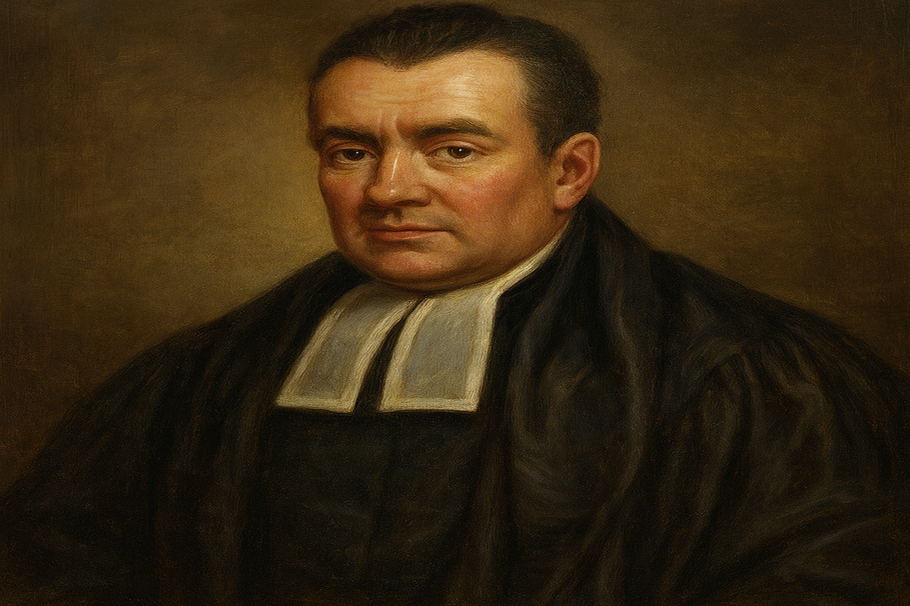

Fermat wirkt daneben fast wie die personifizierte Gelassenheit. Er war Jurist, Parlamentsrat und Richter in Toulouse, also kein Berufsmathematiker im modernen Sinn, sondern ein Gelehrter im Nebenamt – und gerade deshalb ein besonders irritierender Maßstab für andere. Wer tagsüber Recht spricht und abends die Grundlagen der Wahrscheinlichkeit legt, hat einen sehr eigensinnigen Begriff von Freizeit. Zugleich sollte man ihn nicht auf die Korrespondenz mit Pascal verkleinern: Sein späteres geometrisches Werk De linearum curvarum cum lineis rectis comparatione erschien 1660 und war sein einziges mathematisches Werk, das zu Lebzeiten veröffentlicht wurde [Fermat 1660].

Wesentliche Erkenntnisse und Entdeckungen

Die erste wesentliche Erkenntnis von Pascal und Fermat lautet: Eine offene Position wird nicht nach der bereits geschriebenen Geschichte, sondern nach den verbleibenden Zukunftsmöglichkeiten bewertet. Das klingt selbstverständlich, ist aber in Organisationen bis heute keineswegs selbstverständlich. In Diskussionen über Forderungsausfallrisiken, über Projektrisiken oder die Bewertung von Cyberrisiken klebt der Blick oft an der Vergangenheit: Wer hat schon wie viel investiert, wer hat sich "eigentlich" verdient gemacht, wer liegt gefühlt vorne? Wie oft sind bestimmte Cyberrisiken in der Vergangenheit bereits eingetreten? Die Pariser und Toulouser Antwort ist eine andere: All das kann psychologisch verständlich sein, ist aber nicht die richtige Bewertungslogik. Bewertet wird, was noch offen ist.

Die zweite Einsicht ist, dass Fairness unter Unsicherheit nicht romantisch bewertet werden sollte, sondern rational konstruiert werden kann. Fermat zeigt dies über symmetrische Fälle; Pascal zeigt es über Erwartung und Rekursion. Für die Gegenwart ist das verblüffend anschlussfähig. Solvency II definiert den Best Estimate als den erwarteten Barwert zukünftiger Cashflows, der sich als wahrscheinlichkeitsgewichteter Durchschnitt über alle relevanten Szenarien unter Berücksichtigung des Zeitwerts des Geldes ergibt. IFRS 9 verlangt einen unverzerrten, wahrscheinlichkeitsgewichteten Erwartungswert, der aus einer Bandbreite möglicher Ergebnisse unter Berücksichtigung mehrerer Szenarien abgeleitet wird. Anders gesagt: Moderne Aufsicht schreibt im Tonfall des 21. Jahrhunderts häufig dieselbe Vernunft vor, die 1654 erstmals elegant formuliert wurde.

Die dritte Einsicht ist die reifste und für das Risikomanagement vielleicht die wichtigste: Jedes Ergebnis lebt von seinen Annahmen. Das Partienproblem funktioniert, weil die Regeln klar, die Chancen pro Runde gleich und die Zukunftspfade überhaupt sauber beschreibbar sind. In der realen Welt sind Daten oft lückenhaft oder sie fehlen komplett, Abhängigkeiten sind verborgen und Schadenshöhen folgen notorisch einer eigenen – mitunter sehr schmerzhaften – Logik. Genau deshalb ist aus einer frühen Wahrscheinlichkeitstheorie auch eine frühe Lektion in Modellbescheidenheit geworden. Modelle sind auch heute vereinfachte Darstellungen realer Zusammenhänge, deren Grenzen verstanden und angefochten werden müssen.

Das Problem der Partien

Die klassische Version des Problems ist einfach, aber erstaunlich tiefgründig: Zwei Spieler setzen jeweils 32 Goldmünzen (sogenannte "Pistolen") ein. Insgesamt liegen also 64 Münzen im Pot. Gespielt wird eine Serie von Partien – wer zuerst drei gewinnt, erhält den gesamten Einsatz. Beim Spielstand von 2:1 wird das Spiel jedoch abgebrochen. Einer der Spieler führt also, hat aber noch nicht endgültig gewonnen. Die entscheidende Frage lautet nun: Wie wird der Einsatz fair aufgeteilt?

Intuitiv würde man sagen: Der führende Spieler bekommt den größeren Anteil, der andere entsprechend weniger. Doch genau diese grobe Intuition reicht Pascal und Fermat nicht aus. Sie suchen keine "faire" Lösung im Sinne von Gefühl oder Großzügigkeit, sondern einen präzise berechneten Wert – einen objektiven Preis für eine unvollendete Spielsituation.

Fermats Lösung ist die saubere Zählung der noch möglichen Zukunftspfade. Der führende Spieler A braucht noch einen Sieg, der zurückliegende Spieler B noch zwei. Also reichen höchstens zwei weitere Runden bis zur Entscheidung. Unter der Annahme gleicher Chancen pro Runde gibt es vier gleich plausible Fortsetzungen: AA, AB, BA und BB. Nur im letzten Fall gewinnt B die Gesamtserie; in den drei anderen gewinnt A. Also steht der Pot fair im Verhältnis 3:1, also 48 zu 16. Das war nicht deshalb revolutionär, weil die Rechnung so schwer gewesen wäre, sondern weil hier zum ersten Mal die Gegenwart systematisch als Bündel möglicher Zukünfte gelesen wird.

| Zukunftspfad | Runde 1 | Runde 2 | Gewinner Serie | Ergebnis |

|---|---|---|---|---|

| AA | A | A | A gewinnt | |

| AB | A | B | A | A gewinnt |

| BA | B | A | A | A gewinnt |

| BB | B | B | B | B gewinnt |

Tab. 01a: Die Pfadzählung nach Fermat: Zukunft als Menge möglicher Verläufe

| Spieler | Gewinnpfade | Anteil | Auszahlung |

|---|---|---|---|

| A | 3 | 3/4 | 48 |

| B | 1 | 1/4 | 16 |

Tab. 01b: Die Pfadzählung nach Fermat: Zukunft als Menge möglicher Verläufe

Pascal kommt auf dasselbe Ergebnis, aber mit einer Methode, die noch unmittelbarer nach moderner Risikoanalyse klingt. Er trennt einen sicheren von einem unsicheren Teil. Wenn A die nächste Runde verliert, steht es 2:2; in diesem Zustand hätten beide Anspruch auf je 32. Diese 32 kann A also als gesichert betrachten. Strittig bleibt nur die andere Hälfte des Pots. Da die nächste Runde fair ist, steht A von diesem unsicheren Rest im Erwartungswert die Hälfte zu, also 16. Zusammen sind das 48. Fermat zählt; Pascal bewertet. Der eine denkt in Pfaden, der andere in Stufen. Beide erfinden, je auf ihre Weise, die Grammatik rationaler Entscheidungen unter Unsicherheit.

Nicht der bisherige Spielstand ist der faire Preis einer offenen Position, sondern der Wert ihrer noch möglichen Zukünfte.

| Schritt | Betrag | Erklärung |

|---|---|---|

| Sicherer Anteil für A | 32 | Bei 2:2 hätte jeder 32 |

| Unsicherer Rest | 32 | Noch nicht entschieden |

| Erwartungswert unsicherer Teil | 16 | 50% Chance |

| Gesamt für A | 48 | 32 + 16 |

| Gesamt für B | 16 | Rest |

Tab. 02: Die Erwartungswertlogik nach Pascal: Bewertung von Zuständen und Restunsicherheit

Intuitiv liegt die Schönheit des Ganzen darin, dass hier zwei geistige Werkzeuge ineinandergreifen, die bis heute die Risikopraxis prägen: Kombinatorik und Erwartungswert, Szenariopfad und rekursive Bewertung, mögliche Welt und gegenwärtiger Preis. Wer heute Entscheidungsbäume baut, Kreditverluste über Szenarien gewichtet oder einen Stresstest als Bewertungsinstrument versteht, steht geistig näher bei Pascal und Fermat, als er vermutet.

Vom Spiel zur Wissenschaft

Die Episode des Sommers 1654 blieb nicht privat. In maßgeblichen Überblicksdarstellungen gilt der Briefwechsel als Startpunkt der modernen Wahrscheinlichkeitsrechnung. Bereits im Jahr 1657 machte der niederländische Astronom, Mathematiker und Physiker Christiaan Huygens das neue Denken mit "De ratiociniis in ludo aleae" druckfähig und lehrbar. Huygens behauptete, dass ihm die Inhalte des Briefwechsels zwischen Fermat und Pascal nicht bekannt waren. Analysiert man die Lösungen der fünf am Ende seiner Abhandlung aufgeführten Probleme, muss man allerdings vermuten, dass er Pascals Vorstellungen gekannt hat, nicht aber die kombinatorischen Wege von Fermat. Spätere Autoren wie der Schweizer Mathematiker Jakob Bernoulli oder der französische Mathematiker Abraham de Moivre bauten darauf auf. Pascals "Traité du triangle arithmétique" erschien zwar erst im Jahr 1665, wurde aber nach heutiger Editionslage im Kern bereits 1654 ausgearbeitet. Aus einer Spielerfrage wurde also innerhalb weniger Jahre eine Methode, eine Schrift und schließlich eine Disziplin.

Lehren für das Risikomanagement

Die erste Lektion lautet: Erwartungswert schlägt Lautstärke. So verlang beispielsweise IFRS 9 für erwartete Kreditverluste (Expected Credit Loss, ECL) einen unverzerrten, wahrscheinlichkeitsgewichteten Erwartungswert, der sich aus einer Bandbreite möglicher Ergebnisse unter Einbezug vernünftiger und stützbarer Informationen über vergangene Ereignisse, aktuelle Bedingungen und künftige wirtschaftliche Entwicklungen ableitet. Das klingt trocken, ist aber konzeptionell fast schon pascalisch. Nicht die lauteste Ausfallgeschichte gewinnt, sondern die sauber gewichtete Summe der offenen Zukünfte.

Die zweite Lektion lautet: Faire Aufteilung ist Governance. Das Problem der Partien ist die Urform jeder Entscheidung, die mitten in der Unsicherheit und unter unvollständiger Informationslage getroffen werden muss: ein Vergleich mit einem Kreditnehmer, ein Kulanzentscheid im Schadenfall, eine interne Verlustzuordnung nach einem Cybervorfall oder ein Projektabbruch unter Zeitdruck.

Der Rahmen des Baseler Ausschusses für Bankenaufsicht (Basel Committee on Banking Supervision, BCBS) zur operationellen Resilienz fordert deshalb keine deskriptiven Instrumente wie Heatmaps, sondern vor allem belastbare Entscheidungsgrundlagen: die Identifikation kritischer Geschäftsprozesse, die systematische Analyse interner und externer Abhängigkeiten, die Arbeit mit "severe but plausible scenarios" sowie die Festlegung klarer Toleranzgrenzen für Störungen ("tolerance for disruption").

Im Kern geht es dabei um die Fähigkeit, auch unter Unterbrechung konsistente und nachvollziehbare Entscheidungen zu treffen. Genau hier liegt die strukturelle Nähe zur Partien-Logik: Wenn Prozesse abbrechen, Informationen unvollständig sind und Zeitdruck herrscht, braucht es explizite Bewertungsregeln, um verbleibende Optionen fair und rational zu bewerten.

Die dritte Lektion ist die modernste: Modelle sind nützlich, weil sie vereinfachen – und riskant, weil sie vereinfachen. In der wissenschaftlichen Literatur wird seit langem betont, dass Modelle notwendigerweise abstrahieren und damit immer nur eine reduzierte Darstellung der Realität liefern. So formulierte George Box prägnant: "All models are wrong; the practical question is how wrong do they have to be to not be useful."

Genau darin liegt der Kern des Modellrisikos: Es entsteht aus vereinfachenden Annahmen, unsicheren oder verzerrten Eingangsdaten, strukturellen Modellfehlern oder aus einer unangemessenen Anwendung der Modelle. Konsequentes Risikomanagement erfordert daher nicht nur den Einsatz von Modellen, sondern auch deren kritische Hinterfragung, Validierung und kontinuierliche Weiterentwicklung.

Das ist die Kehrseite des eleganten Durchbruchs von 1654: Eine noch so überzeugende Methode bleibt stets an ihre Voraussetzungen gebunden. Wer Unsicherheit quantifiziert, darf die Unsicherheit im Modell selbst nicht ausblenden.

Ein Fallbeispiel: Warum Bauchgefühl nicht reicht

Nehmen wir ein bewusst einfaches und fiktives Beispiel aus der Unternehmenspraxis. Eine mittelgroße Bank betreibt ihren Zahlungsverkehr über eine zentrale Plattform. Die Frage lautet: Lohnt sich eine zweite, georedundante Betriebsumgebung?

Ohne Redundanz schätzt die Bank die jährliche Wahrscheinlichkeit einer schweren Ausfallstörung auf rund 6 Prozent. Der kombinierte Schaden aus Betriebsunterbrechung, Nachbearbeitung, Vertragsstrafen und Kundenfriktion läge im Ereignisfall bei 20 Millionen Euro. Der erwartete jährliche Verlust beträgt damit 0,06 × 20 Millionen = 1,2 Millionen Euro. Die Zahlen sind illustrativ; die Grundlogik hingegen nicht: Sie entspricht der Erwartungswertlogik, mit der Risiken als Kombination aus Eintrittswahrscheinlichkeit und Schadenshöhe bewertet werden.

Mit Redundanz sinkt die Störungswahrscheinlichkeit auf 1,5 Prozent; der Residualschaden läge nur noch bei 6 Millionen Euro. Die zusätzliche Infrastruktur verursacht jedoch jährliche Kosten von 700.000 Euro. Daraus ergibt sich ein erwarteter jährlicher Gesamtaufwand von 0,015 × 6 Millionen = 90.000 Euro Restschaden zuzüglich 700.000 Euro Maßnahmenkosten, insgesamt also 790.000 Euro. Unter der Annahme risikoneutraler Bewertung ist die Redundanz damit ökonomisch vorteilhaft. Man vergleicht sichere Kosten mit wahrscheinlichkeitsgewichteten zukünftigen Verlusten – oder, anders formuliert: Man ersetzt Intuition durch strukturierte Bewertung.

Robust wird die Entscheidung allerdings erst durch eine Sensitivitäts- und Modellprüfung. Was, wenn die 6 Prozent ohne Redundanz überschätzt sind und tatsächlich nur 3 Prozent betragen? Dann läge der erwartete Verlust ohne Maßnahme bei 600.000 Euro – und die Entscheidung könnte kippen. Umgekehrt stellt sich die Frage, ob im Modell alle relevanten Schadenskomponenten enthalten sind: etwa Reputationsverluste, Abhängigkeiten von Drittparteien oder regulatorische Folgekosten. Werden solche Effekte unterschätzt oder nicht berücksichtigt, kann sich die Vorteilhaftigkeit der Redundanz wieder umkehren.

Die Entscheidung hängt somit nicht nur von einer Punktrechnung ab, sondern von der Qualität der Annahmen, der Abdeckung extremer Szenarien und der Stabilität der Ergebnisse gegenüber Modellunsicherheit.

Schluss und Ausblick

Der Würfelwurf, der die Welt veränderte, war nicht deshalb historisch, weil Menschen spielten. Gespielt wurde lange vor Pascal und Fermat. Historisch war, dass sie eine neue Antwort auf eine uralte Lage fanden: Was ist fair, vernünftig und entscheidbar, wenn die Zukunft noch nicht eingetreten ist? Ihre Antwort besteht aus vier Schritten, die bis heute gelten. Man identifiziert mögliche Fortsetzungen. Man gewichtet diese Fortsetzungen. Man übersetzt sie in einen gegenwärtigen Wert. Und man vergisst nie, dass das Ergebnis an Voraussetzungen hängt.

Genau deshalb beruhen viele quantitative Methoden im Risikomanagement so tief auf Ideen des 17. Jahrhunderts. So verändert sich auch der Blick auf Mathematikgeschichte. Dann ist Pascal nicht nur der Mann des Dreiecks, und Fermat nicht nur das Genie der Randnotiz. Dann werden beide zu frühen Architekten einer Denkweise, ohne die weder Kreditsteuerung noch Reservierung, weder Krisen-Governance noch Modellvalidierung seriös denkbar wären. In einer Welt, die Unsicherheit gern moralisiert, dramatisiert oder mit Dashboards dekoriert, bleibt ihre Lektion wohltuend altmodisch: Erst die offenen Möglichkeiten ordnen, dann urteilen.

Quellenverzeichnis sowie weiterführende Literaturhinweise

- Box, George E. P. (1976): Science and Statistics. In: Journal of the American Statistical Association, Vol. 71, No. 356, S. 791-799.

- Pascal, Blaise / Fermat, Pierre de (1679/1654): Correspondance sur les partis et questions de hasard. In: Varia Opera Mathematica Petri de Fermat. Toulouse 1679.

- Pascal, Blaise (1665): Traité du triangle arithmétique, avec quelques autres petits traitez sur la mesme matière. Guillaume Desprez, Paris 1665.

- Huygens, Christiaan (1657): De ratiociniis in ludo aleae. Ex officina J. Elsevirii, Leiden 1657.

- M.P.E.A.S (= Pierre de Fermat) (1660): De linearum curvarum cum lineis rectis comparatione dissertatio Geometrica. Arnaud Colomiez, Toulouse 1660.

- Romeike, Frank (2007): Pierre de Fermat (Köpfe der Risk-Community), in: RISIKO MANAGER, Ausgabe 19/2007, Seite 22-24.